안녕하세요.

호스팅업체에서 일 20Gb 트래픽을 지원받고있습니다.

사이트 가오픈 당시 매일 10GB도 나오지 않아 안심했는데, 정식오픈을 하니 일주일이 넘도록 일 50,60 GB 가 넘네요.

봇들은 대부분 막아놨으며 (robots.txt) , 심지어 검색봇들도 그냥 차단했습니다.

별소용이 없는걸보아.. 봇때문에 생긴 문제가 아닌 정상 유저들 증가로 생긴일 같습니다.

저희사이트가 이미지가 메인인 사이트라 더 심할거같고요..

(일주일사이 갑자기 늘어났네요^^ㅠ)

질문은 이렇습니다.

이런 상황에서 트래픽 대역폭을 제한하려 합니다.

1. mod_ratlimit

해당 모듈이 트래픽 제어 모듈이라는 설명을 들었습니다.

모듈 설명으론 유용해보이는데 xetown 도 그렇고 많은 사람이 사용하진않더라구요. 이 방법이 아닐까요?

2. nginx 제어

https://junyoungs.blogspot.com/2014/08/nginx.html?m=1

(참고: https://xetown.com/questions/774073)

nginx 에서 직접 제어하는 방법입니다.

저같은 상황에서 이렇게 하는게 맞나요?

2-1. 2번 방법이라면, 대역폭을 얼마로 제한해야하나요?

계산하기 편하게, 일일 트래픽 지원이 24GB 라고한다면

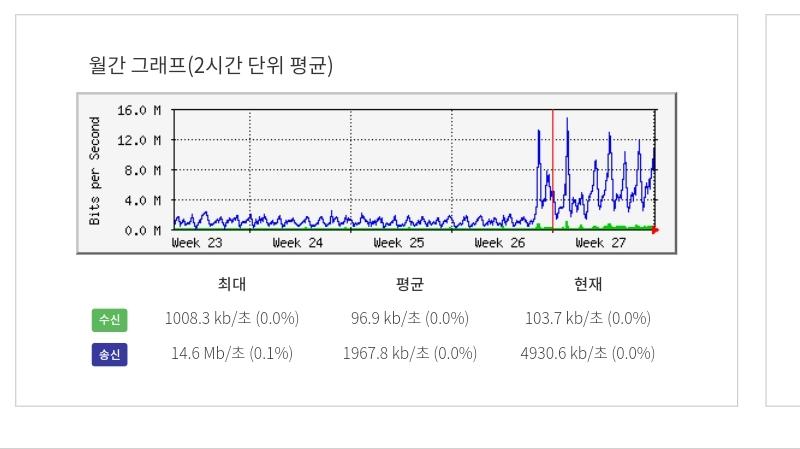

(스샷에서 보시다 싶이 전송기준이 /sec 이므로)

24시간 24GB

1시간 1GB

...

1초 약 250KB

이므로

nginx.conf 수정

location ... {

최대 대역폭

limit_rate 200k; <<얘를 250kb 로 수정 (k 는 아니고 kb 쓰는게 맞겠죠?)

일정 용량을 전송 제한

limit_rate_after 원하는용량M; << 이 부분은 이해하지 못했습니다.

}

250kb 로 제한하는게 맞을까요?

2-2 일정 용량을 전송 제한

limit_rate_after 원하는용량M; << 이 부분은 이해하지 못했습니다.

이부분은 따로 설정없이 모든 대역폭을 제한하고싶으면 0Mb 으로 하는건가요, 아예 이 구절을 빼도 되는걸까요?

감사합니다.